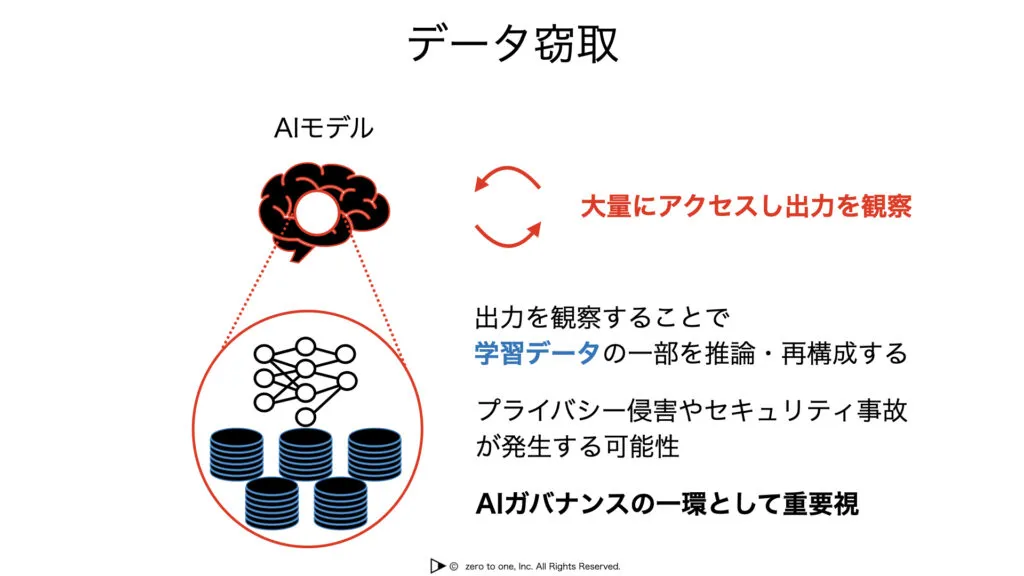

データ窃取

データ窃取とは、AIモデルに対して入力を与え、出力結果(ラベルや信頼スコアなど)や勾配情報を観察・解析することで、学習データの一部を推論・再構成する攻撃手法です。

特に、AIが機微情報(個人データや機密情報など)を含むデータで学習している場合、それらが外部から推測可能になり、情報漏えいにつながるリスクがあります。入力データが学習に使われたかを判定するメンバーシップ推論攻撃や、出力や勾配から学習データを再構成するモデル反転攻撃などが代表的です。 このような攻撃により、プライバシー侵害やセキュリティ事故が発生する可能性があるため、AIガバナンスの観点からも、出力の制御・アクセス制限・暗号化といった技術的・運用的対策が不可欠です。安全で信頼性のあるAIの社会実装を支えるうえで、データ窃取への対策は重要な要素です。

👉より体系的に学びたい方は「人工知能基礎」(東京大学松尾豊先生監修)へ

モデル窃取に関する説明として正しいものを選べ

人工知能基礎講座を提供中

人工知能の第一人者である東京大学の松尾豊教授が監修した人工知能基礎講座を受講してみませんか?

人工知能の歴史から自然言語処理、機械学習、深層学習といった最先端のトピックやAIに関わる法律問題まで網羅しているので全てのビジネスパーソン・AIの初学者におすすめです。

サンプル動画

AI初学者・ビジネスパーソン向けのG検定対策講座

zero to oneの「E資格」向け認定プログラム

日本ディープラーニング協会の実施するE資格の受験ならzero to oneの「E資格」向け認定プログラム (税込165,000円) をおすすめします。当講座は、東京大学大学院工学系研究科の松尾豊教授と東北大学大学院情報科学研究科の岡谷貴之教授が監修する実践的なプログラムとなっています。

厚生労働省の教育訓練給付制度対象のE資格認定プログラムの中では最安値※となり、実質負担額49,500円~(支給割合70%の場合)で受講可能です。※2023年弊社調べ