Multi-Head Attention

Multi-Head Attentionは、Transformerという自然言語処理モデルの重要な構成要素の一つです。

Transformerにおいては、従来の手法で用いられていた畳み込みニューラルネットワークやリカレントニューラルネットワークを完全に排除し、Attention機構という仕組みに基づいて予測を行っています。

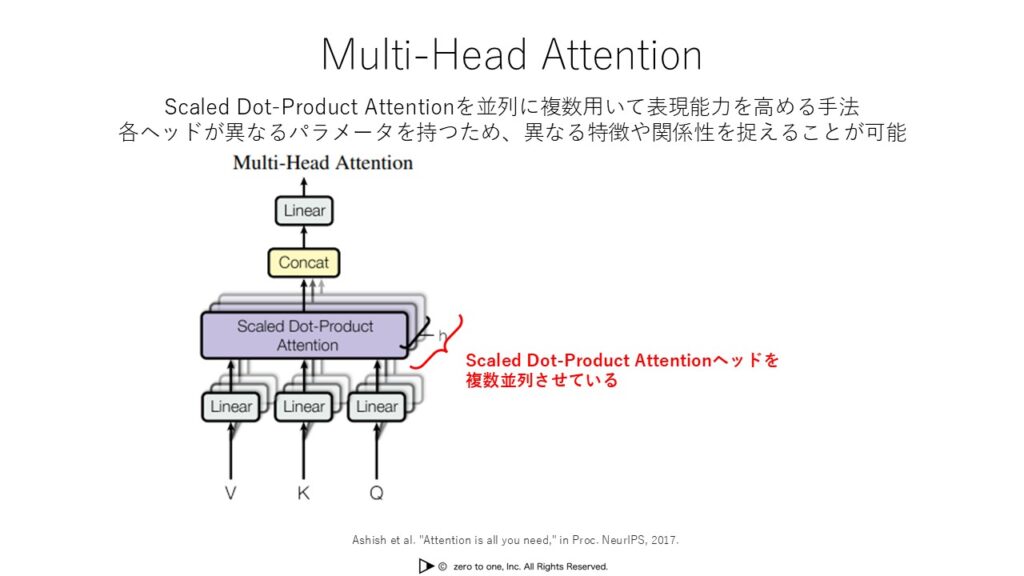

Transformerに用いられているAttention機構はMulti-Head Attentionとも呼ばれ、Scaled Dot-Product Attentionを並列に複数用いて表現能力を高める構造になっています。Scaled Dot-Product Attention内部では、Attention機構のより詳細な計算処理が行われています。

Multi-Head Attentionでは各ヘッドが異なるパラメータを持つため、異なる特徴や関係性を捉えることが可能であり、例えば文の異なる部分に焦点を当てたり、異なる意味の関係を捉えたりすることができます。

👉より体系的に学びたい方は「人工知能基礎」(東京大学松尾豊先生監修)へ

人工知能基礎講座を提供中

人工知能の第一人者である東京大学の松尾豊教授が監修した人工知能基礎講座を受講してみませんか?

人工知能の歴史から自然言語処理、機械学習、深層学習といった最先端のトピックやAIに関わる法律問題まで網羅しているので全てのビジネスパーソン・AIの初学者におすすめです。

サンプル動画

AI初学者・ビジネスパーソン向けのG検定対策講座

zero to oneの「E資格」向け認定プログラム

日本ディープラーニング協会の実施するE資格の受験ならzero to oneの「E資格」向け認定プログラム (税込165,000円) をおすすめします。当講座は、東京大学大学院工学系研究科の松尾豊教授と東北大学大学院情報科学研究科の岡谷貴之教授が監修する実践的なプログラムとなっています。

厚生労働省の教育訓練給付制度対象のE資格認定プログラムの中では最安値※となり、実質負担額49,500円~(支給割合70%の場合)で受講可能です。※2023年弊社調べ