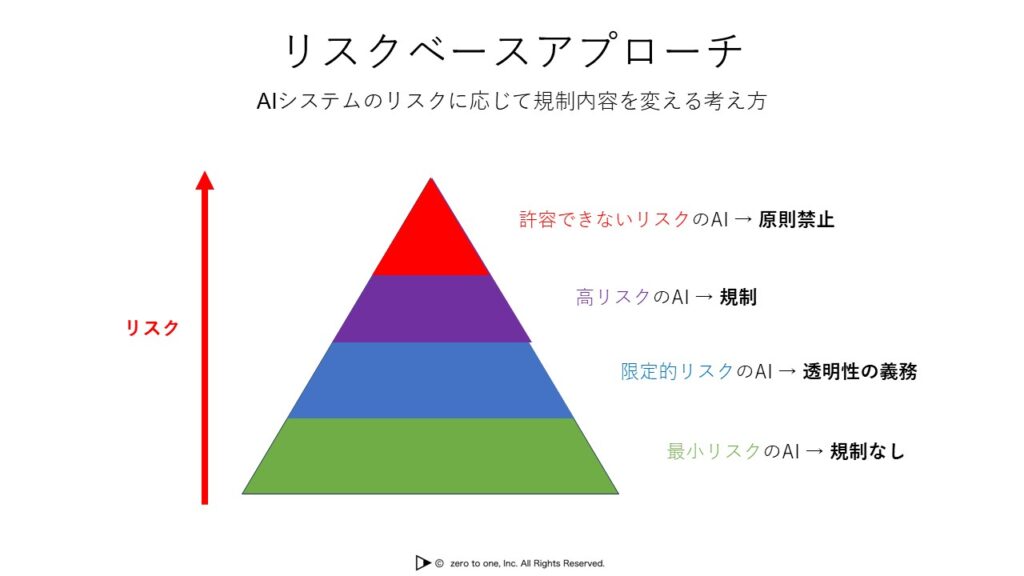

リスクベースアプローチ

リスクベースアプローチとは、AIのガイドラインにおいて、AIシステムのリスクに応じて規制内容を変える考え方です。

具体的にはリスク段階が「許容できないリスク」、「ハイリスク」、「限定的リスク」、「最小リスク」と設定され、それぞれのリスクに応じて「原則禁止」、「規制」、「透明性の義務」、「規制なし」のように規制内容が設定されます。リスクが高いシステムほど、開発者・導入者の責任や透明性がより重視される仕組みにするというわけです。

👉より体系的に学びたい方は「人工知能基礎」(東京大学松尾豊先生監修)へ

AIのガイドラインに関連して、リスクベースアプローチの説明として最も適切な選択肢を一つ選べ。

人工知能基礎講座を提供中

人工知能の第一人者である東京大学の松尾豊教授が監修した人工知能基礎講座を受講してみませんか?

人工知能の歴史から自然言語処理、機械学習、深層学習といった最先端のトピックやAIに関わる法律問題まで網羅しているので全てのビジネスパーソン・AIの初学者におすすめです。

サンプル動画

AI初学者・ビジネスパーソン向けのG検定対策講座

zero to oneの「E資格」向け認定プログラム

日本ディープラーニング協会の実施するE資格の受験ならzero to oneの「E資格」向け認定プログラム (税込165,000円) をおすすめします。当講座は、東京大学大学院工学系研究科の松尾豊教授と東北大学大学院情報科学研究科の岡谷貴之教授が監修する実践的なプログラムとなっています。

厚生労働省の教育訓練給付制度対象のE資格認定プログラムの中では最安値※となり、実質負担額49,500円~(支給割合70%の場合)で受講可能です。※2023年弊社調べ