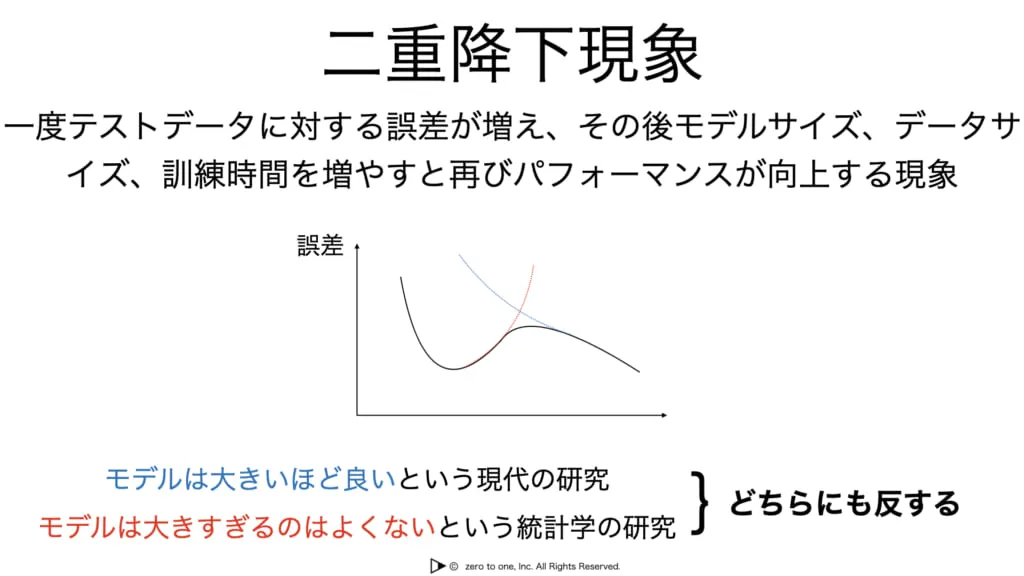

二重降下現象

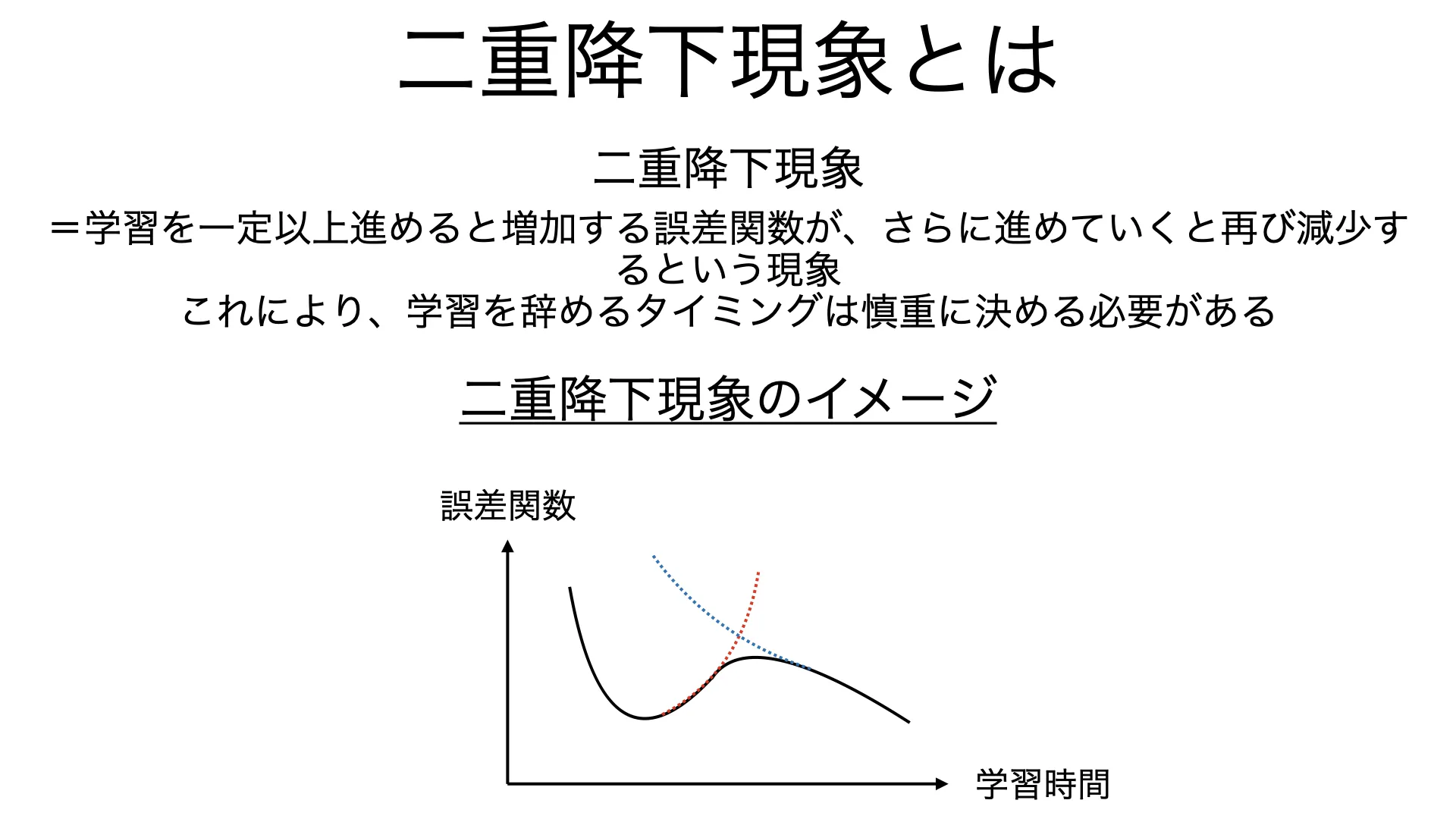

二重降下現象

二重降下現象はCNN,ResNet,Transformerなどの多くの深層学習モデルにおいて、正則化などを行わないと現れる現象です。

この現象では一度誤差が減少したもののまた増加し、それに対してモデルサイズ、データサイズ、訓練時間を増やすことによって再びモデルの精度が向上するといったことが生じます。この現象はモデルは大きいほど良いという現代のMLパラダイムの考え、モデルは大きすぎるのはよくないという統計学の研究どちらにも反した結果となっています。この現象ではより大きな訓練データで学習するとパフォーマンスが低下してしまうことを示唆しています。

👉より体系的に学びたい方は「人工知能基礎」(東京大学松尾豊先生監修)へ

クイズ

誤差関数はパラメータが少ない時には大きく、多い時には少ないという特徴(バイアス・分散トレードオフ)という性質があるが、それを超えてパラメータが多大になると再び誤差関数が減少しだす(A)という現象が生じることがある。この誤差関数の挙動に合わせて適切なタイミングで学習を止める必要があるが、学習を止めるタイミングとして誤差関数が増加し始めた時点で学習を停止する(B)がある。

人工知能基礎講座を提供中

人工知能の第一人者である東京大学の松尾豊教授が監修した人工知能基礎講座を受講してみませんか?

人工知能の歴史から自然言語処理、機械学習、深層学習といった最先端のトピックやAIに関わる法律問題まで網羅しているので全てのビジネスパーソン・AIの初学者におすすめです。

サンプル動画

AI初学者・ビジネスパーソン向けのG検定対策講座

zero to oneの「E資格」向け認定プログラム

日本ディープラーニング協会の実施するE資格の受験ならzero to oneの「E資格」向け認定プログラム (税込165,000円) をおすすめします。当講座は、東京大学大学院工学系研究科の松尾豊教授と東北大学大学院情報科学研究科の岡谷貴之教授が監修する実践的なプログラムとなっています。

厚生労働省の教育訓練給付制度対象のE資格認定プログラムの中では最安値※となり、実質負担額49,500円~(支給割合70%の場合)で受講可能です。※2023年弊社調べ

(参考: G検定公式テキスト 第3版,p.171,172,181,183,385)

(参考: G検定公式テキスト 第3版,p.171,172,181,183,385)